Präsentation einbetten

Als PDF, PPTX herunterladen

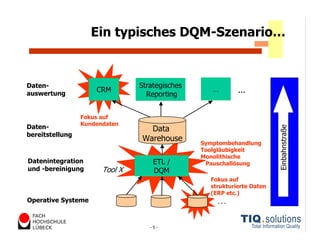

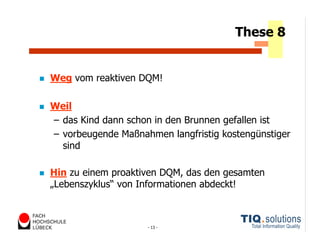

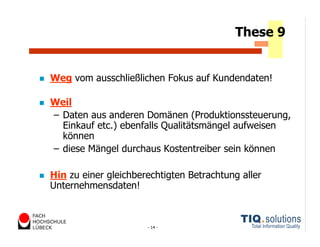

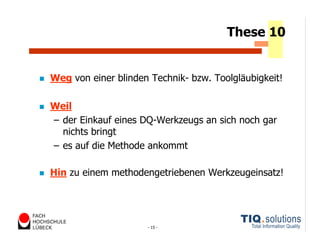

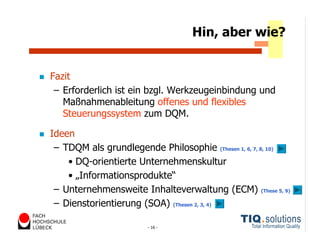

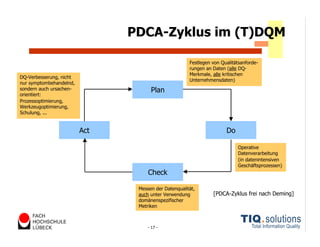

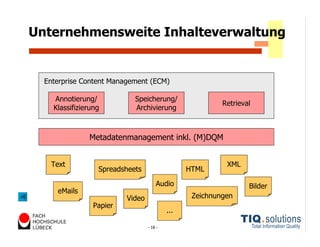

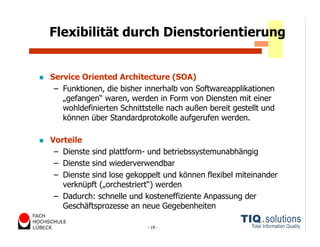

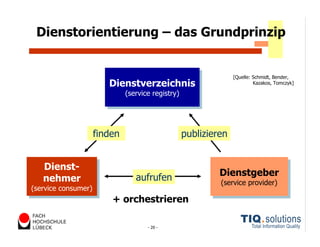

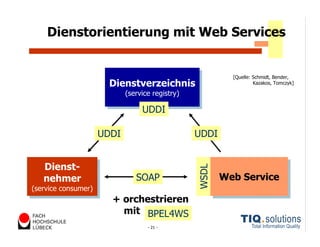

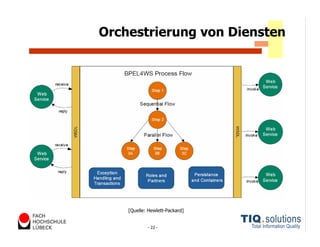

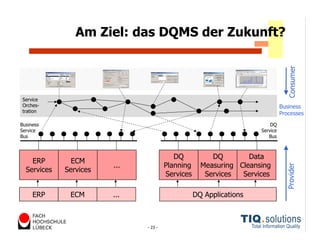

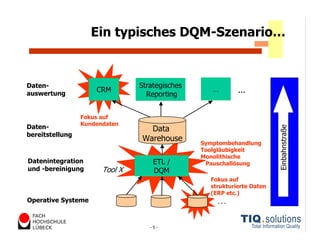

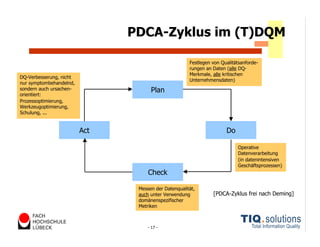

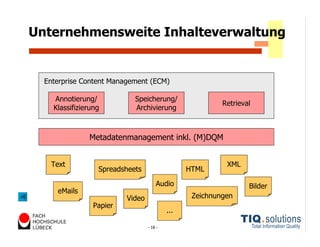

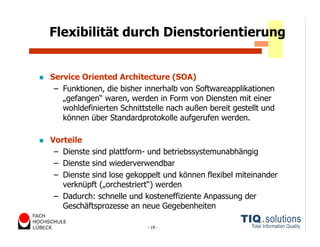

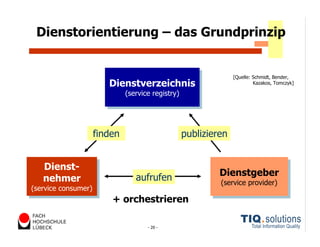

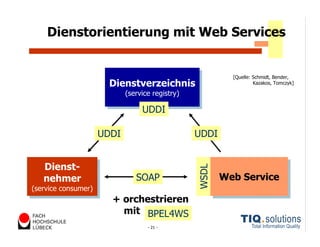

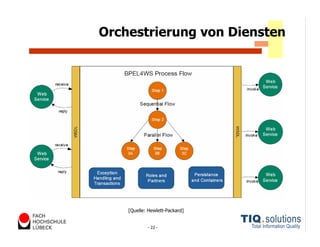

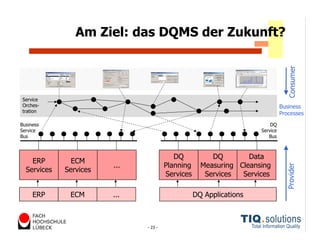

Das Dokument stellt zehn Thesen zum Datenqualitätsmanagement (DQM) vor, die auf die Notwendigkeit von Ursachenorientierung, individueller Anpassung von Lösungen und die Einbeziehung aller Datenquellen hinweisen. Es kritisiert monolithische Systeme und einen engen Fokus auf Kundendaten und betont die Wichtigkeit einer unternehmensweiten Datenqualitätskultur sowie flexibler, serviceorientierter Architekturen. Abschließend wird ein Umdenken bei Unternehmen und Beratern gefordert, um ein zukunftsfähiges DQM zu fördern.