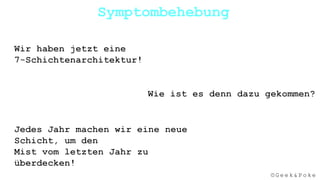

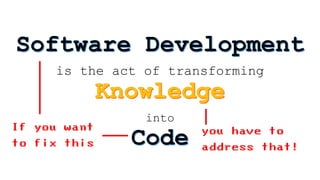

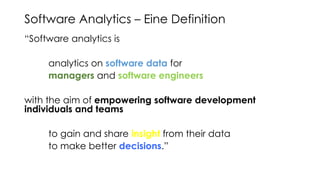

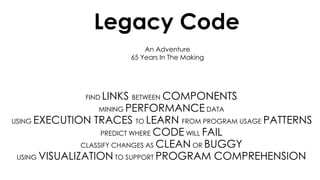

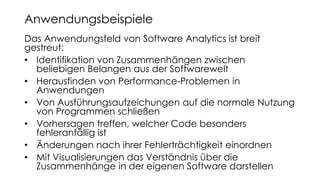

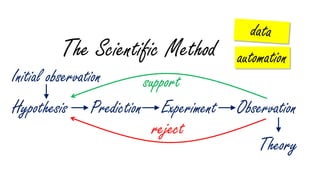

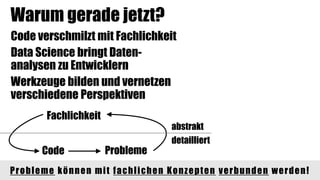

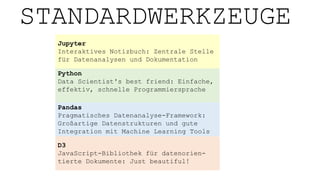

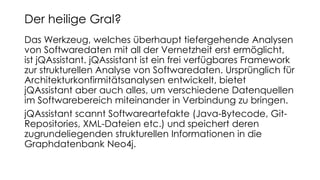

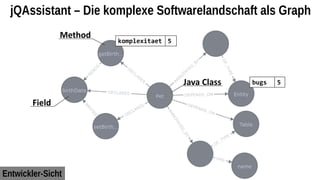

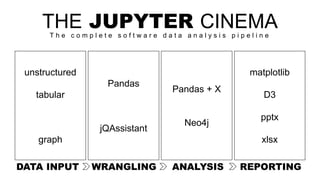

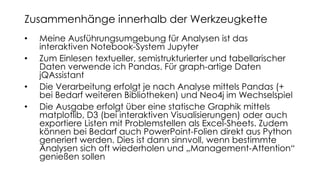

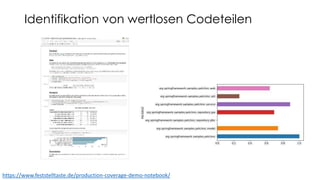

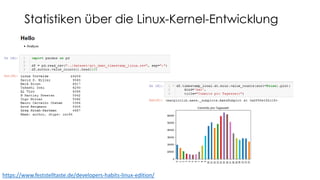

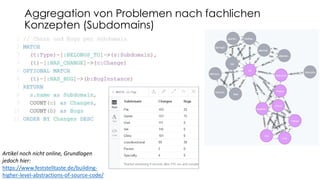

Der Vortrag von Markus Harrer thematisiert die Notwendigkeit und Durchführung von Datenanalysen in der Softwareentwicklung, um Problemursachen zu identifizieren und gemeinsam Lösungen zu entwickeln. Durch den Einsatz von Open-Source-Analysetools und einem digitalen Notizbuchansatz wird demonstriert, wie wertvolle digitale Spuren in der Software helfen können, Herausforderungen wie Race-Conditions und Performance-Probleme zu bewältigen. Die Verbindung von Management und Entwicklungsabteilungen durch gezielte Datenanalysen soll die Basis für fundierte Entscheidungen und strategisches Refactoring von Legacy-Systemen schaffen.