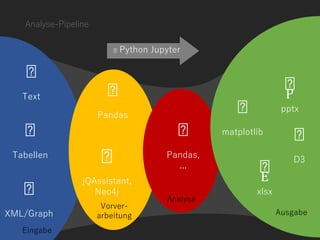

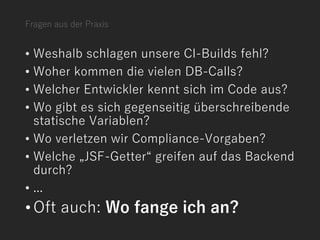

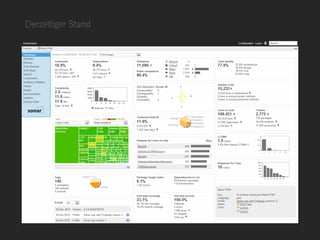

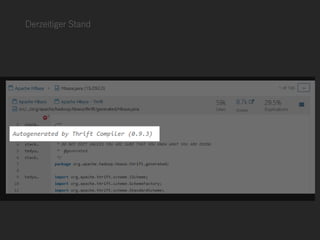

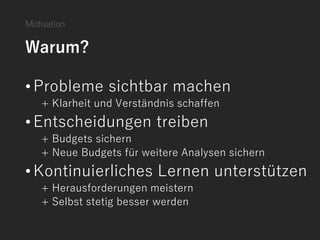

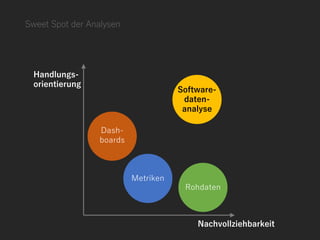

Die Präsentation thematisiert datengetriebene und automatisierte Analysen in der Softwareentwicklung, um klare Erkenntnisse über Probleme wie fehlschlagende CI-Bauten und ineffiziente Datenbankaufrufe zu gewinnen. Sie betont die Notwendigkeit von Nachvollziehbarkeit und Automatisierung in der Datenanalyse und bietet Lösungen, um kontinuierliches Lernen zu fördern und die Entscheidungsfindung zu verbessern. Verschiedene Ansätze zur strukturierten Analyse und der Einsatz von Tools werden vorgestellt, um Herausforderungen in der Softwareentwicklung zu meistern.

![Die Spezialisten (insb. graphartige Daten)

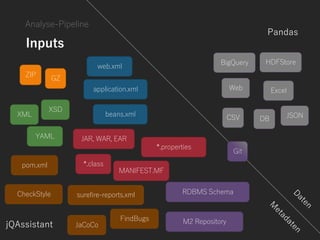

Analyse-Pipeline

Framework zur statischen

Architektur- und Code-

Analyse

Graph-Datenbank

[:SPEICHERT_IN]](https://image.slidesharecdn.com/nachvollziehbaredatengetriebeneautomatisierteanalysendersoftwareentwicklungdevelopercamp2017-170517170020/85/Nachvollziehbare-datengetriebene-automatisierte-Analysen-der-Softwareentwicklung-DeveloperCamp2017-26-320.jpg)