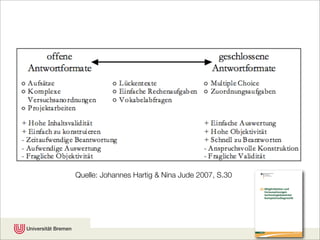

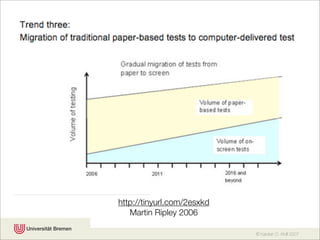

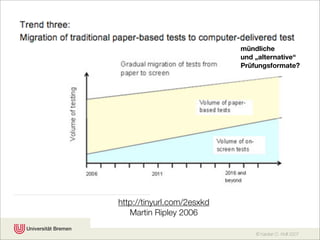

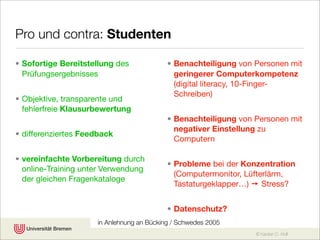

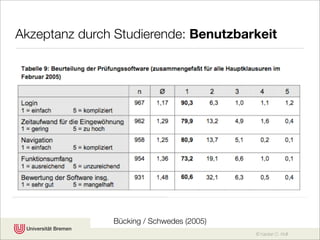

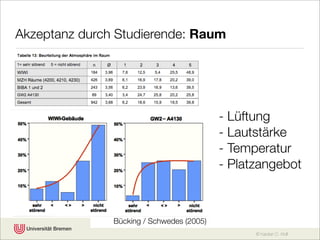

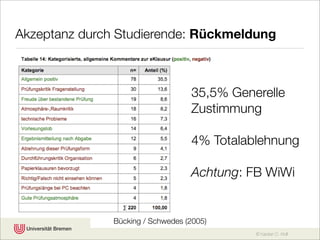

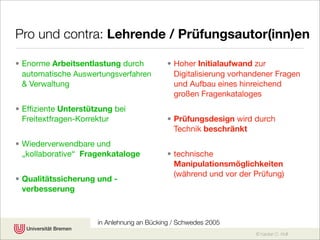

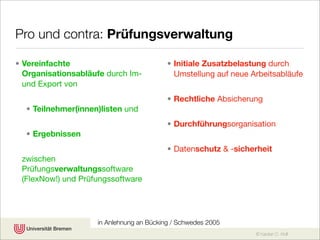

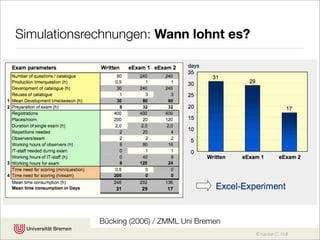

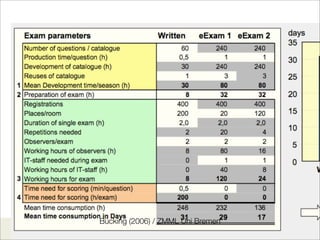

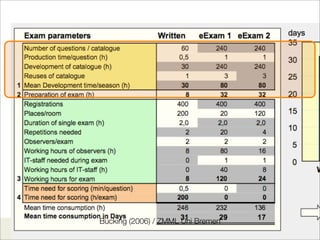

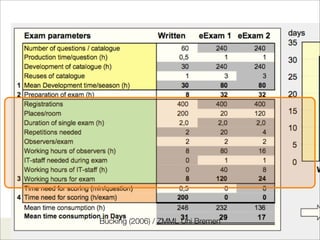

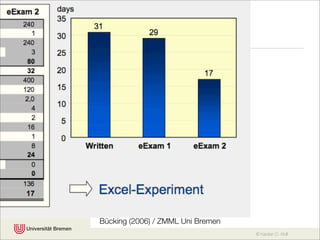

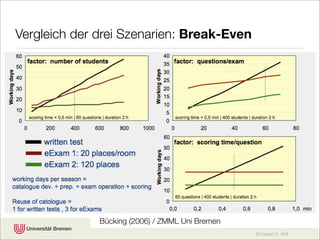

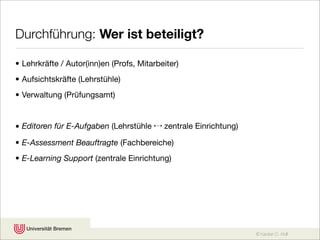

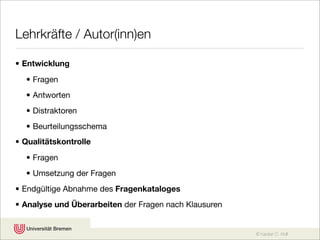

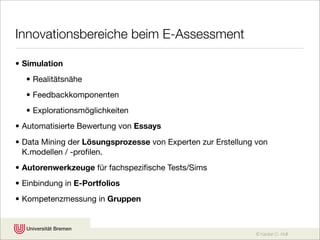

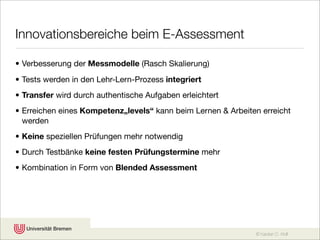

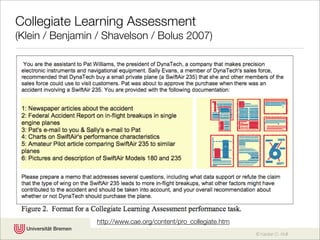

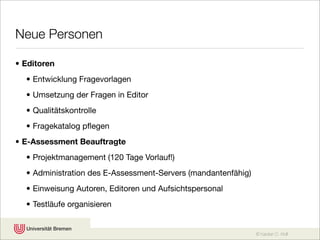

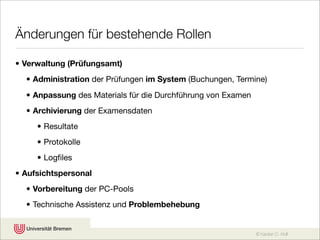

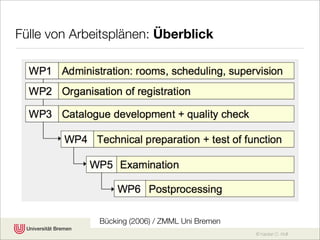

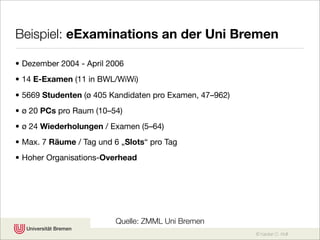

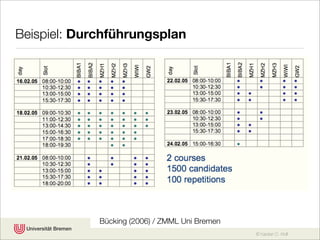

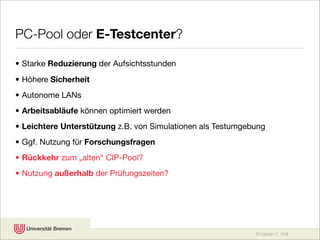

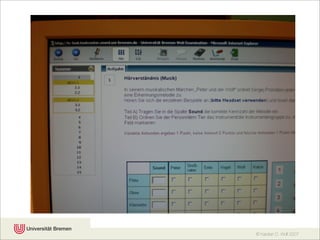

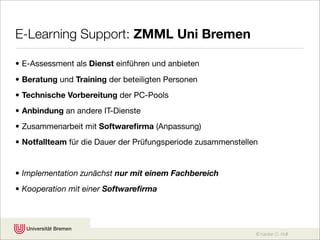

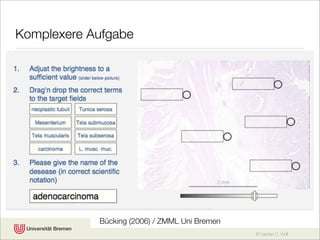

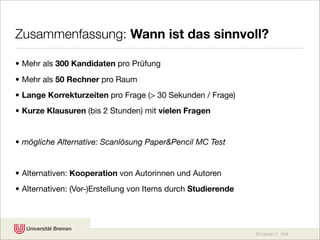

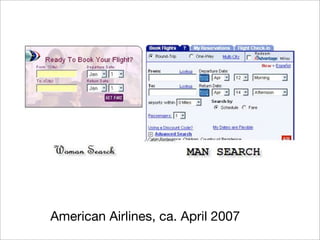

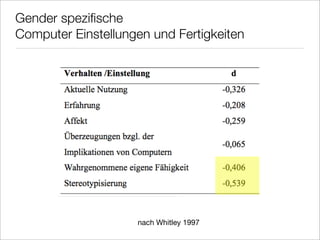

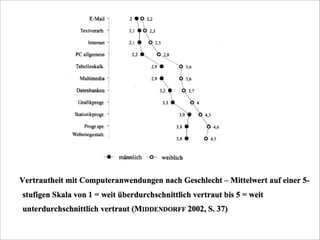

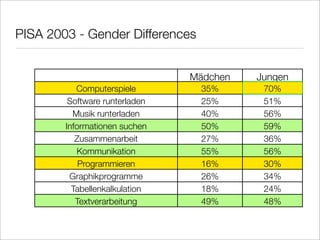

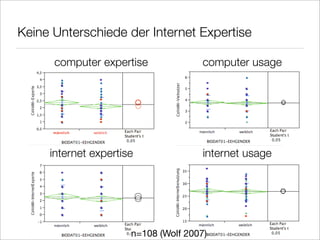

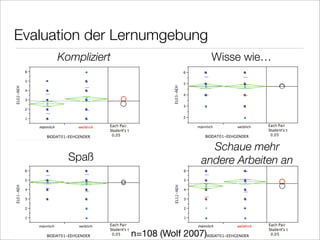

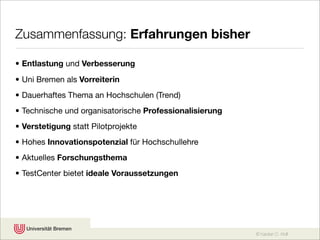

Das Dokument von Karsten D. Wolf diskutiert die Chancen und Herausforderungen bei der Einführung von E-Assessments an Universitäten, einschließlich der Akzeptanz durch Studierende und Lehrende sowie der notwendigen organisatorischen und technischen Veränderungen. Es werden Pro- und Contra-Argumente für E-Assessments aufgeführt, wie die Verbesserung der Bewertungseffizienz und die potenziellen Herausforderungen bezüglich Datenschutz und Computerkompetenz. Die Implementierung erfordert sorgfältige Planung und Schulung, um die Vorteile des digitalen Prüfungsformats zu maximieren.