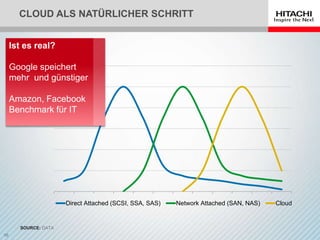

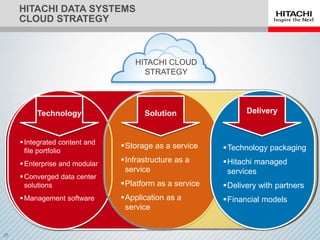

Das Dokument beschreibt die Philosophie und Vorteile einer real dynamischen Infrastruktur (RDI) und der Cloud-Konzepte, die Unternehmen dabei helfen, hohe Investitions- und Betriebskosten zu reduzieren, eine flexible Ressourcenverwaltung zu ermöglichen und die Geschäftsabläufe zu optimieren. Es werden verschiedene Cloud-Modelle wie private, public und hybrid vorgestellt, sowie deren Anwendungsbereiche und die Rolle von Hitachi Data Systems bei der Bereitstellung von Cloud-Lösungen. Ziel ist es, Mitarbeitern zu ermöglichen, sich auf das Geschäft zu konzentrieren, während die IT-Infrastruktur effizient verwaltet wird.