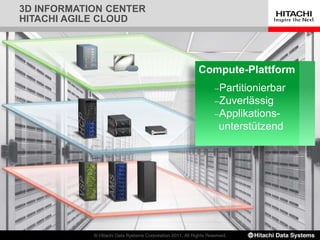

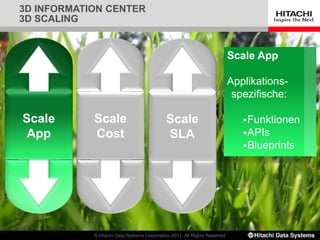

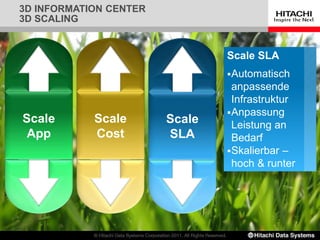

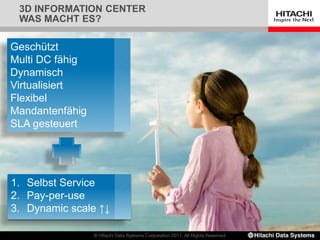

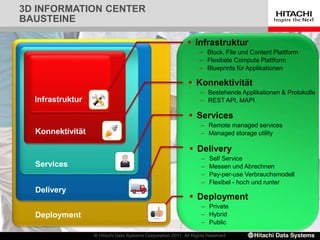

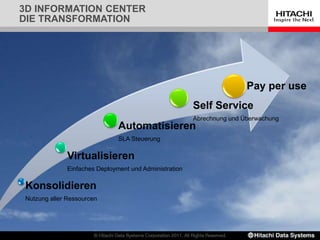

Das Dokument beschreibt das 3D Information Center von Hitachi, das eine agile Cloud-Lösung für das Datenmanagement bietet, um mit dem exponentiellen Datenwachstum umzugehen. Es betont die Notwendigkeit einer flexiblen, automatisierten und SLA-gesteuerten Infrastruktur, die auf die Geschäftsbedürfnisse fokussiert ist. Zentrale Aspekte sind die Transparenz der Kosten, die Möglichkeit des Self-Service und die Anpassungsfähigkeit der Ressourcen im Rahmen von pay-per-use-Modellen.