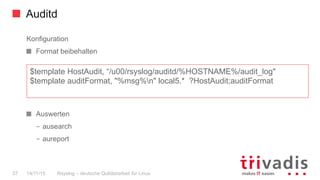

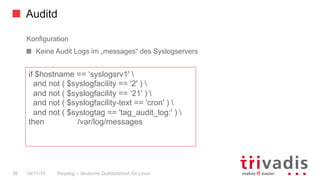

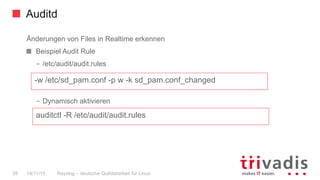

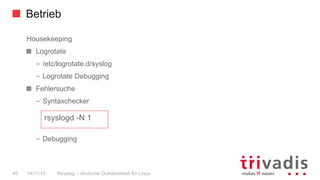

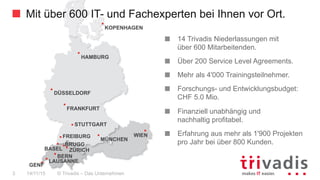

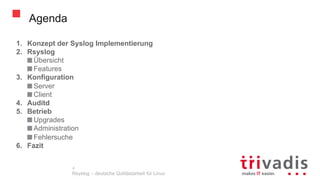

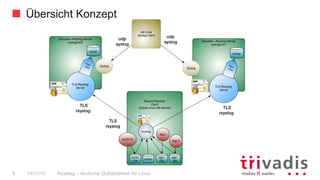

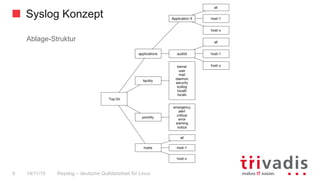

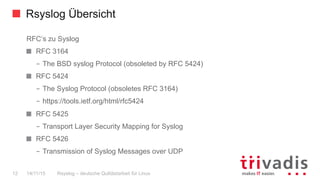

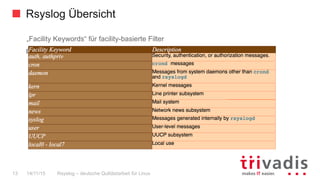

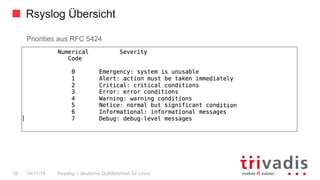

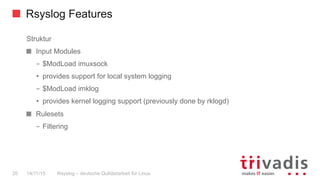

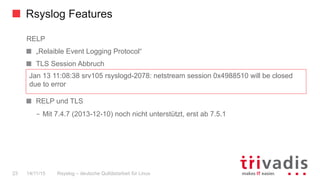

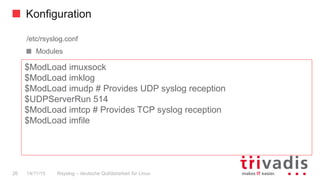

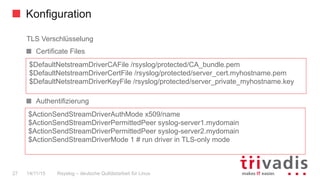

Das Dokument beschreibt die Dienstleistungen und Expertise der Trivadis AG im Bereich IT-Consulting und Systemintegration, sowie die Implementierung und Konfiguration von rsyslog, einem zentralen Syslog-Dienst für Linux-Distributionen. Es werden die Features, Konfigurationsbeispiele und Anwendungsfälle von rsyslog erläutert, einschließlich Sicherheitsaspekte wie TLS-Verschlüsselung. Zudem gibt es Informationen über die Leistungsfähigkeit und Modularität von rsyslog sowie Tipps zur Fehlerdiagnose und Betriebshandhabung.

![Konfiguration

Rsyslog – deutsche Qulitästarbeit für Linux33 14/11/15

Regex

POSIX ERE oder BRE

Online Regex Checker

– http://www.rsyslog.com/regex/

:msg, regex, "sshd.* session opened for user q[a-z0-9]*[0-9]”

/lfs/oracle_audit/os.log](https://image.slidesharecdn.com/rsyslogdeutschequalittsarbeitfuerlinux-romangaechter-151209150306-lva1-app6891/85/Rsyslog-Deutsche-Qualitatsarbeit-fur-Linux-33-320.jpg)