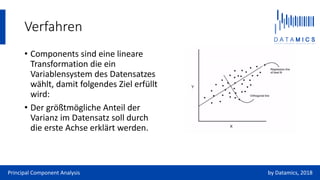

Die Hauptkomponentenanalyse (PCA) ist ein Verfahren der multivariaten Statistik, das zum Ziel hat, die Beziehung zwischen Variablen eines Datensatzes zu untersuchen, indem es umfangreiche Daten strukturiert und vereinfacht. Durch die Bestimmung orthogonaler Achsen wird eine maximale Varianz erklärt, was die Analyse und Interpretation von Daten erleichtert. Anwendungsbeispiele zeigen, wie PCA bei der Analyse von Schiffsdaten und Konsumverhalten eingesetzt werden kann, während die Interpretation der gewonnenen Komponenten eine Herausforderung darstellt.