[PRML] パターン認識と機械学習(第2章:確率分布)

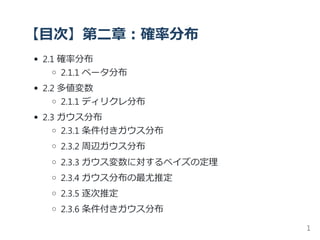

- 1. 【目次】第二章:確率分布 2.1 確率分布 2.1.1 ベータ分布 2.2 多値変数 2.1.1 ディリクレ分布 2.3 ガウス分布 2.3.1 条件付きガウス分布 2.3.2 周辺ガウス分布 2.3.3 ガウス変数に対するベイズの定理 2.3.4 ガウス分布の最尤推定 2.3.5 逐次推定 2.3.6 条件付きガウス分布 1

- 2. 【目次】第二章:確率分布 2.3 ガウス分布 2.3.7 スチューデントの t 分布 2.3.8 周期変数 2.3.9 混合ガウス分布 2.4 指数型分布族 2.4.1 最尤推定と十分統計量 2.4.2 共役事前分布 2.4.3 無情報事前分布 2.5 ノンパラメトリック法 2.5.1 カーネル密度推定法 2.5.2 最近傍法 2

- 3. 2.1 ベルヌーイ分布 二値確率変数 x ∈ 0, 1 が 1 となる確率を μ とするとき、x の 離散確率分布 Bern(x∣μ) = μ (1 − μ) μ=0.7 のときのベルヌーイ分布 http://qiita.com/katsu1110/items/b0213c7ef6a8122abfc5 { } x 1−x 3

- 4. ベルヌーイ分布の性質 ベルヌーイ分布の期待値 E[x] = μ ベルヌーイ分布の分散 var[x] = μ(1 − μ) 4

- 5. 2.1 二項分布 大きさが N のあるデータ集合のうち、x = 1 となる観測値の数 m の分布 Bin(m∣N, μ) = μ (1 − μ) https://ja.wikipedia.org/wiki/二項分布 ( N m ) m N−m 5

- 6. 二項分布の性質 二項分布の期待値 E[x] = Nμ 二項分布の分散 var[x] = Nμ(1 − μ) 6

- 7. 2.1.1 ベータ分布 ベルヌーイ分布や二項分布の共役事前分布 Beta(μ∣a, b) = μ (1 − μ) https://ja.wikipedia.org/wiki/ベータ分布 Γ(a)Γ(b) Γ(a + b) a−1 b−1 7

- 8. ベータ分布の性質 E[μ] = , var[μ] = ガンマ関数 Γ はベータ分布が正規化されることを保証 超パラメータa、bはx = 1とx = 0の有効観測数として解釈 可能 a + b a (a + b) (a + b + 1)2 ab 8

- 9. 2.2 多値変数 9

- 10. 多項分布 N 個の独立なベルヌーイ試行における成功の数の確率分布 Mult(m , m , ⋯ , m ∣μ, N) = μ K = 2 のとき、多項分布は二項分布となる 1 2 K ( m m ⋯ m1 2 K N ) k=1 ∏ K k mk 10

- 11. 2.2.1 ディリクレ分布 ベータ分布を多変量に拡張した連続型の確率分布(多項分布の共 益事前分布) Dir(μ, α) = μ 3変数のディリクレ分布( α = 0.1, α = 1, α = 10) Γ(α ) ⋯ Γ(α )1 K Γ(α )0 k=1 ∏ K k α −1k { k} { k} { k} 11

- 12. 2.3 ガウス分布 D次元ベクトルxに対する多変量ガウス分布 N(x∣μ, Σ) = exp − (x − μ) Σ (x − μ) 記号 意味 μ D次元の平均ベクトル Σ D × Dの共分散行列(ただし正定値・半正定値) ∣Σ∣ Σの行列式 (2π)D/2 1 ∣Σ∣1/2 1 { 2 1 T −1 } 12

- 13. マハラノビス距離 多次元のデータの相関を考慮した距離 Δ = (x − μ) Σ (x − μ) Σ が単位行列ならば、ユークリッド距離となる Σ が対角行列ならば、次元ごとのスケールが異なる Σ が非対角行列ならば、スケールと回転が加わる { T −1 } 1/2 13

- 14. D次元ガウス分布の期待値と分散 ガウス分布の1次モーメント(期待値) E[x] = μ ガウス分布の2次モーメント E[xx ] = μμ + Σ ガウス分布の分散 E[xx ] − E[x] = Σ T T T 2 14

- 15. ガウス分布の考察 パラメータ総数がD(D + 3)/2個であるため、大規模計算が 困難 Σ は対称行列であるため、D(D + 1)/2 μの大きさは、D 二次元での確率密度の描かれ方 共分散行列が一般共分散行列ならば、任意の方向に楕円 形を描く(分布の自由度:高) 共分散行列が対角共分散行列ならば、座標軸方向に楕円 形を描く(分布の自由度:中) 共分散行列が等方共分散行列ならば、球面を描く(分布 の自由度:低) ガウス分布は単峰形(極大値が1つ)であるため、多峰形の分 布を近似できない 15

- 16. 逆行列の補助定理(Woodburyの恒等式) 行列A、B、C、Dに対して (A + BD C) = A − A B(D + CA B) CA Woodburyの恒等式が活躍する3つの条件 A の逆行列は既に求まっている 左項を求めたい C が横長行列、B が縦長行列 −1 −1 −1 −1 −1 −1 −1 16

- 17. 2.3.1 条件付きガウス分布 条件付きガウス分布 p(x ∣x ) = N(x ∣μ ,Σ ) 平均値 μ = μ +Σ Σ (x −μ ) 分散 Σ =Σ −Σ Σ Σ a b a a∣b aa −1 a∣b a ab bb −1 b b a∣b aa ab bb −1 ba 17

- 18. 部分行列の逆行列 部分行列A, B, C, Dで構成される行列の逆行列 = ただし、シューア補行列﴾Schur complement matrix﴿Mは、 M = (A − BD C) ( A C B D ) −1 ( M −D CM−1 −MBD−1 D +D CMBD−1 −1 −1) −1 −1 18

- 19. 2.3.2 周辺ガウス分布 周辺分布 p(x ) = N(x ∣μ ,Σ ) 期待値 E[x ] =μ 共分散 cov[x ] =Σ a a a aa a a a aa 19

- 20. 2.3.3 ガウス変数に対するベイズの定理 xの周辺ガウス分布と、xが与えられたときのyの条件付きガウス 分布が与えられるとき、 p(x) = N(x∣μ,Λ ) p(y∣x) = N(y∣Ax + b,L ) p(y) = N(y∣Aμ + b, AΛ A ) yの周辺分布と、yが与えられたときのxの条件付き分布 p(x∣y) = N(x∣Σ A L(y − b) + Λμ , Σ) Σ = (Λ +A LA) −1 −1 −1 ⊤ { ⊤ } ⊤ −1 20

- 21. 2.3.4 ガウス分布の最尤推定 対数尤度関数 ln p(x∣μ, Σ) = − ln (2π) − ln ∣Σ∣ − (x − μ) Σ (x − μ) μの導関数を0として解く(最尤推定による平均) μ = x Σの導関数を0として解く(最尤推定による分散) Σ = (x −μ )(x −μ ) 2 ND 2 N 2 1 n=1 ∑ N n ⊤ −1 n ML N 1 n=1 ∑ N n ML N 1 n=1 ∑ N n ML n ML ⊤ 21

- 22. 2.3.5 逐次推定 全てのデータ点を一度に一括処理することが不可能な大規模デー タ処理で有効 μ =μ + (x −μ )ML (N) ML (N−1) N 1 N ML (N−1) 22

- 24. 分散σ を既知とする1変数のガウス分布 の尤度関数 p(x∣μ) = p(x ∣μ) = exp − (x − μ) その共役事前分布は p(μ) = N(μ∣μ , σ ) 2 n=1 ∏ N n (2πσ )2 2 N 1 { 2σ2 1 n=1 ∑ N n 2 } 0 0 2 24

- 25. 平均μを既知とする1変数のガウス分布の 尤度関数 p(x∣λ) = p(x ∣λ ) = λ exp − (x − μ) その共役事前分布は Gam(λ∣a, b) = b λ exp (−bλ) ※分散について考えることは可能であるが(その共役事前分布は逆 ガンマ分布)、簡潔でないため精度を用いた n=1 ∏ N n −1 2 N { 2 λ n=1 ∑ N n 2 } Γ(a) 1 a a−1 25

- 26. 平均 μ と精度 λ が未知の1変数のガウス 分布の尤度関数 尤度関数 p(x∣μ, λ) = exp − (x − μ) ∝ λ exp − exp λμ x − x 事前分布 p(μ, λ) ∝ λ exp − exp (cλμ − dλ) = exp − (μ − ) λ exp − d − λ n=1 ∏ N ( 2π λ ) 2 1 { 2 λ n 2 } [ 2 1 ( 2 λμ2 )] N { n=1 ∑ N n 2 λ n=1 ∑ N n 2 } [ 2 1 ( 2 λμ2 )] β { 2 βλ β c 2 } 2 β { ( 2β c2 ) } 26

- 27. 正規-ガンマ分布 先の式にa = (1 + β)/2、及びb = d − c /2β を代入すると、 p(μ, λ) = N(μ∣μ , (βλ) )Gam(λ∣a, b) μ と λ が独立な事前分布を選んでも、事後分布では μ の分布の精 度と λ の間に関連が生じる 2 0 −1 27

- 28. D次元変数多変量ガウス分布の尤度関数 D 次元変数の多変量ガウス分布N(x∣μ, Λ )の場合、 共役事前分布は 精度が既知ならば、⇒ガウス分布 平均が既知ならば、⇒ウィシャート分布 平均と精度が未知ならば、⇒正規‐ウィシャート分布 −1 28

- 29. ガウス分布の尤度関数のまとめ 共益事前分布 1 次元変数 D 次元変数 平均だけが未知 ガウス分布 ガウス分布 精度だけが未知 ガンマ分布 ウィシャート分布 分散だけが未知 逆ガンマ分布 逆ウィシャート分布 平均と精度が未 知 ガウス‐ガンマ分 布 ガウス‐ウィシャート分 布 29

- 30. 2.3.7 スチューデントの t 分布 1変数のガウス分布における精度の共役事前分布で、積分消去と変 数置換により求められる St(x∣μ, λ, ν) = 1 + ν = 1のとき、コーシー分布 ν → ∞のとき、ガウス分布 Γ(ν/2) Γ(ν/2 + 1/2) ( πν λ ) 1/2 [ ν λ(x − μ)2 ] −2 ν 2 1 30

- 33. フォン・ミーゼス分布 θ を分布の平均、mを集中度パラメータ、I (m)を正規化定数と した円周上に定義される連続型の確率分布 p(θ∣θ , m) = exp m cos(θ − θ ) 引用:https://ja.wikipedia.org/wiki/フォン・ミーゼス分布 0 0 0 2πI (m)0 1 { 0 } 33

- 34. 2.3.9 混合ガウス分布 ガウス分布は多峰性を表現できないため、データの特徴をうまく 捉えることができない 2つの塊の中央部分は疎であるが、左図ではここに大きな確率を割 り当ててしまう 34

- 35. 混合ガウス分布の確率密度関数 ガウス分布を重ね合わせた連続型の確率密度関数 p(k) = π N(x∣μ ,Σ ) 条件 π = 1, 0 ≤ π ≤ 1 k=1 ∑ K k k k k=1 ∑ K k k 35

- 36. 2.4 指数型分布族 確率質量・密度関数が指数関数として表せるような確率分布 p(x∣η) = h(x)g(η) exp η u(x) 正規化条件 g(η) h(x) exp η u(x) dx = 1 { ⊤ } ∫ { ⊤ } 36

- 37. ベルヌーイ分布における指数型分布族の 標準形 Bern(x∣μ) = μ (1 − μ) = (1 − μ) exp ln 指数部をηとしてμについて解くと、ロジスティックシグモイド関 数となる σ(η) = u(x) = x、h(x) = 1、g(η) = σ(−η)とした時、次式で表せる p(x∣μ) = σ(−η) exp (ηx) x 1−x { ( 1 − μ μ )} 1 + exp (−η) 1 37

- 38. 多項分布における指数型分布族の標準形 Mult(x∣μ) = μ = exp x ln μ u(x) = x、h(x) = 1、g(η) = 1とした時、次式で表せる p(x∣η) = exp (η x) k=1 ∏ M k xk { k=1 ∑ M k k} ⊤ 38

- 39. 2.4.1 最尤推定と十分統計量 指数型分布族という分布の集合を考えるメリットは、指数型分布 族が一般的に良い性質を持っている p(x∣η) = h(x)g(η) exp η u(x) u(x) の n 次モーメントは g﴾η﴿ の n 階微分で表現可能 パラメータの最尤推定解が、実データの加算平均と一致 http://s0sem0y.hatenablog.com/entry/2016/05/25/025947 { ⊤ } 39

- 40. 2.4.2 共役事前分布 f(χ, ν)は正規化定数,ν は有効な事前の仮想観測値の数 p(η∣χ, ν) = f(χ, ν)g(η) exp νη χν { ⊤ } 40

- 41. 2.4.3 無情報事前分布 分布がどのような形状になるべきかについて知見があまりない場 合、事後分布に影響の少ない無情報事前分布を用いる 全ての確率が均等となるような分布を事前分布とする場合 λ の定義域が有界でないなら、λ 上での積分が発散してしま うため、事前分布は正しく正規化できない(変則事前分布) 非線形な変数変換をした時、λ 上の確率密度が定数にならな いこと ⇒ 適切な無情報事前分布とは 41

- 42. 平行移動不変性を持つ確率密度 区間A ≤ μ ≤ Bに入る確率が、区間A − c ≤ μ ≤ B − cに入る 確率と等しい事前確率分布 p(x∣μ) = f(x − μ) なお、p(μ − c) = p(μ)であるため、p(μ)は定数である 42

- 43. 尺度不変性を持つ確率密度 区間A ≤ μ ≤ Bに入る確率が、区間A/c ≤ μ ≤ B/cに入る確 率と等しい事前確率分布 p(σ) = p σ p(σ) ∝ 1/σである。この分布は0 ≤ σ ≤ ∞での積分が発散する ため、変則事前分布である。 ( c 1 ) σ 1 43

- 44. 2.5 ノンパラメトリック法 パラメトリック法の場合、データを生成した分布を表現するのに は貧弱なモデルである場合がある ex. 単峰性のガウス分布で多峰性のあるデータを表現できない 手法 説明 パラメトリック データが何らかの分布に由来すると考える ノンパラメトリ ック データに一切の分布(パラメータ)を仮定し ない手法 44

- 46. 密度推定法 ある D 次元ユークリッド空間中の未知の確率密度 p(x) から得ら れる N 個の観測値から p(x) の値を推定する データ点が領域 R 内にある確率を P とする時、二項分布が 鋭く尖るのに十分な K 個の点が R 内に存在する K ⋍ NP p(x) が領域 R 内でほぼ一定とみなせるほど十分に小さい P ⋍ p(x)V 46

- 47. 密度推定法_2 前式から、領域R内の体積V と点の総数Kに関する密度推定量を 導出 p(x) = Kを固定し、データからV の値を推定する ⇒カーネル密度推定法 V を固定し、データからKの値を推定する ⇒K 近傍密度推定法 NV K 47

- 49. 2.5.2 最近傍法 データ空間内の位置に応じてカーネル幅 h を変更する p(x∣C ) = K /N V ,p(x) = K/NV ,p(C ) = N /Nから p(C ∣x) = = k k k k k k p(x) p(x∣C )p(C )k k K Kk 49