Generalization of Principal Component Analysis, presentation, 2012

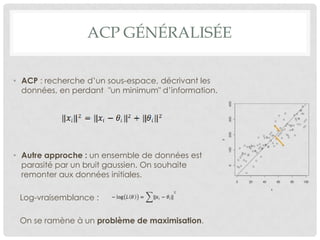

- 1. ACP GÉNÉRALISÉE • ACP : recherche d’un sous-espace, décrivant les données, en perdant "un minimum" d’information. • Autre approche : un ensemble de données est parasité par un bruit gaussien. On souhaite remonter aux données initiales. Log-vraisemblance : On se ramène à un problème de maximisation.

- 2. POURQUOI GÉNÉRALISER L’ACP ? • Inutilisable pour des distributions discrètes (entières ou binaires). Le bruit suivrait plutôt respectivement une loi de Poisson ou de Bernoulli. • Si le bruit n’est pas gaussien, par exemple s’il est imposé strictement positif (analyse textuelle, analyse d’images). On l’étend à tout type de bruit appartenant à la famille exponentielle. Le prix sera de rendre plus complexe la distance : on n'utilise plus la distance euclidienne mais la distance de Bregman. On l'étend de la même manière qu'on étend régression GLM.

- 3. FAMILLE EXPONENTIELLE Famille définie par : • Theta est le paramètre naturel (cherché) • P0 Est constant en θ(donc n’intervient pas dans les calculs) • G caractérise le type de distribution. Un résultat très important : • Une distribution gaussienne est un cas particulier d’une famille exponentielle, • Donc tous les résultats coïncideront avec l’ACP "classique", puisqu’elle sera un cas particulier de l’ACP généralisée.

- 4. DISTANCE DE BREGMAN • Définition : • Intuition : elle mesure "à quel point F est convexe". • Généralisation : • f peut être remplacée par un grad. • La distance de Bregman de 2 matrices/vecteurs est la somme des distances terme à terme. Utilité : on lie la log-vraisemblance à cette distance. Donc maximiser la vraisemblance revient à minimiser cette distance.

- 5. LIEN AVEC LE PROBLÈME ACP classique maximiser la vraisemblance projeter en norme euclidienne ACP généralisée maximiser la vraisemblance projeter en norme de Bregman Pour un bruit gaussien Pour un bruit de loi appartenant à la famille exponentielle

- 6. CONCEPT DE L’ACP GÉNÉRALISÉE • Dans la "nouvelle base" V… • … on cherche les "nouveaux vecteurs" Θ… • … de coordonnées A. On cherche A et V dans Θ=AV. • Tels que la distance de Bregman entre les données observées (x) et les données déduites (θ) soit minimale.

- 7. ALGORITHME • V est choisi aléatoirement, • On minimise successivement A et V : Tout point limite est un point stationnaire.